إيلاف شبش

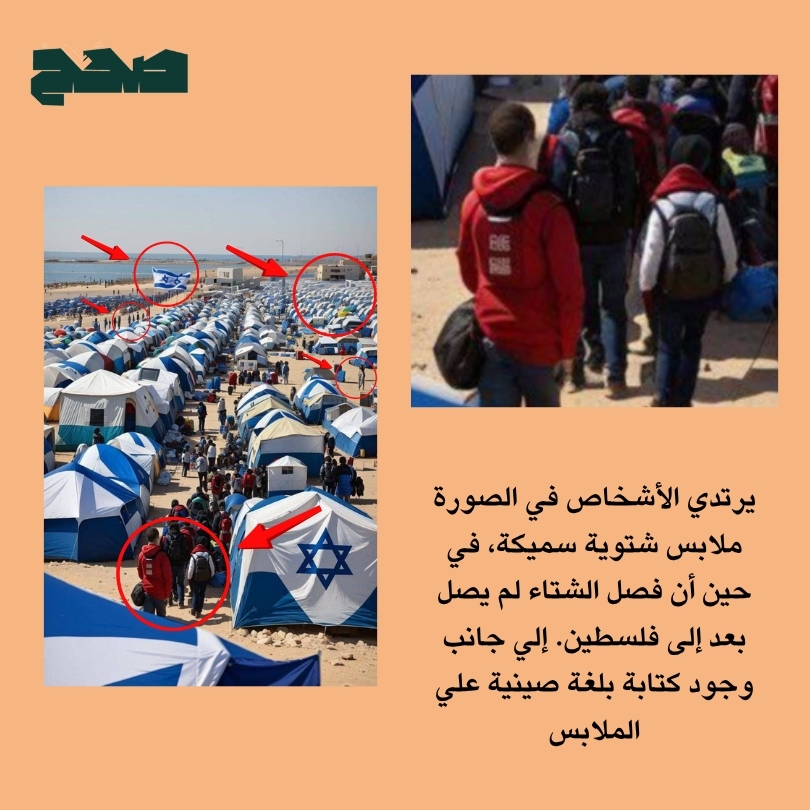

تداولت وسائل التواصل الاجتماعي خلال الأيام الماضية صورة تُظهر ما قيل إنه “أول مخيم للاجئين الإسرائيليين” نتيجة ضربات صاروخية إيرانية استهدفت تل أبيب. يمكن ايجاد الادعاء هنا وهنا

إلا ان هذا الادعاء مفبرك

وبعد التحقق تبين ان الصورة ظهرت لأول مرة في أكتوبر 2023، ضمن منشورات غير موثوقة على الإنترنت. ثم أُعيد تداولها في يونيو 2025، مترافقة مع تصعيد عسكري بين إيران وإسرائيل. يمكن ايجاد الادعاء هنا

وبعد تحليل الصورة تبين الاتي:

الصورة لمخيم اللاجئين الإسرائيليين تم إنشاؤها باستخدام الذكاء الاصطناعي، وهي ليست صورة حقيقية لأي حدث ميداني.الهدف من تداولها هو التضليل الإعلامي وإثارة البلبلة، وهو ما يدخل ضمن حرب معلومات شاملة بين أطراف الصراع في المنطقة.

الذكاء الاصطناعي كأداة تضليل بصري

أصبح الذكاء الاصطناعي أداة فعالة في توليد صور تبدو واقعية، لكنها في الحقيقة لا تمثل أي حدث حقيقي. وتُستخدم هذه الصور بشكل متزايد في حملات التضليل البصري، خصوصًا خلال النزاعات والأزمات.

أولًا: تقنيات التوليد المستخدمة

– الشبكات التوليدية التنافسية (GANs)

– نماذج الانتشار (Diffusion Models)، وهي الأكثر تطورًا حاليًا.

ثانيًا: أبرز أدوات توليد الصور المنتشرة حاليًا

Midjourney-

(من OpenAI)DALL·E3-

(من Stability AI) Stable Diffusion

Adobe Firefly-

Leonardo AI-

(خاصة في الصور والفيديو)Runway ML-

(يعتمد على DALL·E)Bing Image Creator –

Playground AI –

(لدمج الوجوه والمشاهد)Artbreeder-

Dream by WOMBO

ثالثًا: آلية العمل

– تعمل هذه الأدوات من خلال إدخال وصف نصي (Prompt)، يقوم الذكاء الاصطناعي بتحويله إلى صورة.

– على سبيل المثال: إدخال وصف مثل “مخيم كبير على شاطئ البحر به خيام وأعلام إسرائيلية” يمكن أن ينتج عنه صورة تبدو حقيقية ومقنعة، رغم أنها خيالية تمامًا

رابعاً: صعوبة التمييز

– تتطور هذه التقنيات بسرعة، مما يجعل من الصعب على المستخدم العادي التمييز بين الصور الحقيقية والمفبركة.

– هذه الصور غالبًا ما تحتوي على تفاصيل غير متقنة (مثل ملامح غير طبيعية، أعلام مشوهة، أيدٍ بعدد أصابع غير طبيعي)، لكن يصعب ملاحظتها من النظرة الأولى.